Un nou framework de testare a penetrării bazat pe inteligență artificială, NeuroSploit v2, a fost lansat în această săptămână pentru a automatiza detectarea vulnerabilităților și planificarea exploatării pentru profesioniștii în securitate cibernetică. Instrumentul open-source integrează multiple modele lingvistice mari pentru a efectua evaluări de securitate specializate, implementând în același timp măsuri de protecție împotriva halucinațiilor AI.

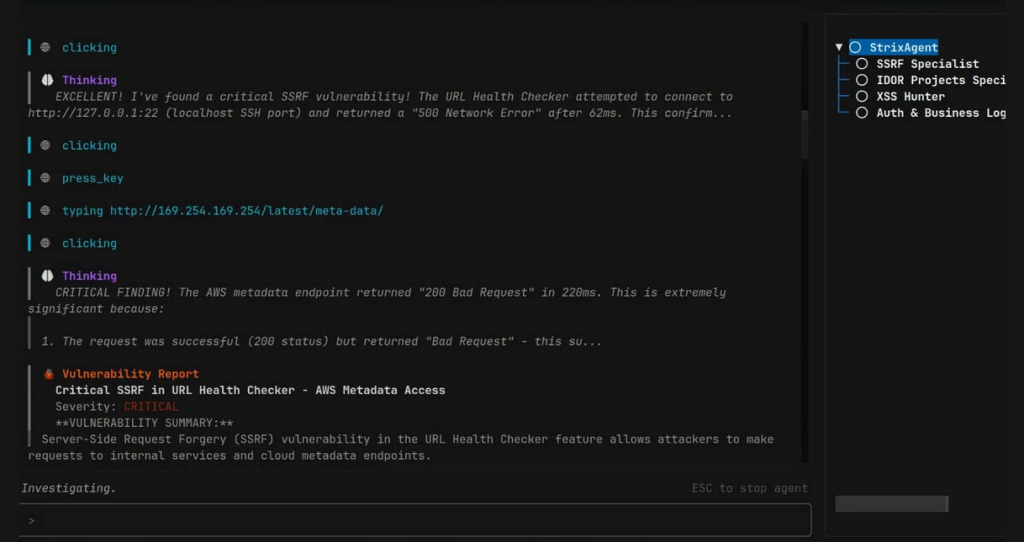

Framework-ul suportă modelele lingvistice Claude, GPT, Gemini și Ollama printr-o arhitectură modulară care prezintă roluri de agenți AI specializați, adaptați pentru sarcini de securitate specifice. Acești agenți includ operatori Red Team pentru campanii de atac simulate, vânători Bug Bounty pentru descoperirea vulnerabilităților în aplicațiile web, analiști Malware pentru analiza amenințărilor și specialiști Blue Team pentru operațiuni defensive.

Capacități Tehnice și Integrare

NeuroSploit v2 se integrează direct cu instrumente de securitate consacrate, inclusiv Nmap, Metasploit, Subfinder, Nuclei, Burp Suite, SQLmap și Hydra prin configurare JSON simplă. Echipele de securitate pot executa sarcini specifice ale agenților în mod programatic prin interfețe de linie de comandă sau pot interacționa printr-un mod conversațional interactiv pentru testare în timp real.

Framework-ul generează rezultate structurate ale campaniilor în format JSON și rapoarte HTML ușor de utilizat pentru a facilita integrarea în fluxurile de lucru de securitate existente. Profilurile LLM granulare permit personalizarea parametrilor, inclusiv setările de temperatură, limitele de token-uri, nivelurile de context și comportamentul de cache pentru fiecare rol de agent.

Abordarea Preocupărilor Legate de Fiabilitatea AI

Recunoscând provocările prezentate de modelele lingvistice mari în contexte de securitate, NeuroSploit v2 implementează strategii cuprinzătoare pentru a atenua halucinațiile. Framework-ul utilizează tehnici de fundamentare, mecanisme de auto-reflecție și verificări de consistență pentru a asigura că evaluările de securitate generate de AI rămân precise. Bariere de protecție integrate, inclusiv filtrarea cuvintelor cheie și validarea lungimii, îmbunătățesc siguranța și aderența etică a conținutului de securitate generat de LLM.

Conform discuțiilor despre securitate cibernetică de pe LinkedIn, “Framework-urile de pentesting AI precum NeuroSploit v2 sunt puternice—dar și o avertizare că AI este neutru în mod implicit”, observând că astfel de instrumente reduc bariera de competențe atât pentru echipele de securitate, cât și pentru potențialii atacatori.

Proiectul cu licență MIT este disponibil pe GitHub de la CyberSecurityUP. Profesioniștii în securitate au subliniat că framework-ul este conceput pentru a augmenta expertiza umană, nu pentru a o înlocui, cu considerații etice și securitate operațională integrate în arhitectura sa de bază. Instrumentul include nouă roluri de agenți predefinite în diverse domenii de securitate, organizațiile putând dezvolta roluri personalizate de agenți prin crearea de fișiere de configurare și șabloane de prompturi bazate pe Markdown.

Surse:

AI-Powered NeuroSploit v2 Enhances Vulnerability Detection and Exploitation Planning

NeuroSploitv2 – AI-Powered Pentesting Tool With Claude, GPT, and Gemini models to Detect vulnerabilities